記事・レポート

「AI時代における企業経営者の意思決定とは」

IESE × アカデミーヒルズ 共催セミナー

更新日 : 2019年08月20日

(火)

前編 AI時代だからこそ増す経営者の責任

世界トップクラスのビジネススクールでスペイン、バルセロナに本拠を置くIESEビジネススクールとのコラボレーションで実施しているセミナーシリーズ。今回は、AIによって変わる組織の在り方と経営者の意思決定を考えました。

人間には過去の経験や環境によって作られたバイアスが存在しますが、ビッグデータによって裏打ちされたアルゴリズムであるAIは、そうしたバイアスなく物事を分析、予測することが出来ると言われています。企業経営者の役割の一つが不確実な世界における意思決定であるとすれば、AIは経営者の意思決定にどのようなインパクトを与えるのでしょうか?

開催日時:2019年5月17日 (金) 19:00~21:00

スピーカー:

福原正大 (Institution for a Global Society CEO/Founder,大学院大学至善館特任教授)

Franz Heukamp (ESE学長)

モデレーター:野田智義 (大学院大学至善館 創設者・理事長,全人格リーダーシップ教育機関アイ・エス・エル(ISL)創設者)

記事提供元・撮影:IESE東京オフィス

日々、躍進的な進化を続ける人工知能(AI)。アルファ碁が世界チャンピオンを打ち負かし、自律走行アルゴリズムがタクシーを運転するようになったいま、経営トップの責任である意思決定にもAIを活用する動きがみえている。

自ら学びながら最適な答えを導き出すAIに、何をどこまで、そしてどう委ねるか。それは、世界中のエグゼクティブが直面している難題だ。

AIと人間をどう使い分けるべきなのか?倫理的なAI活用法とは? そして、AI時代に求められる経営者像とは何なのか?

はじめに、MITの工学博士であり不確実性のもとでの意思決定分析の専門家として名高いIESEのフランツ・ホイカンプ学長、およびAIに基づく人材採用ツール開発会社「IGS」の創設者で至善館大学特任教授の福原正大氏が登壇し、経営におけるAIの未来について洞察を共有した。

その後、至善館大学の野田智義理事長の司会のもと、参加者からの質問も交えながら繰り広げられた白熱の議論を振り返ってみたい。

人間は理不尽な動物だ。

人間は理不尽な動物だ。

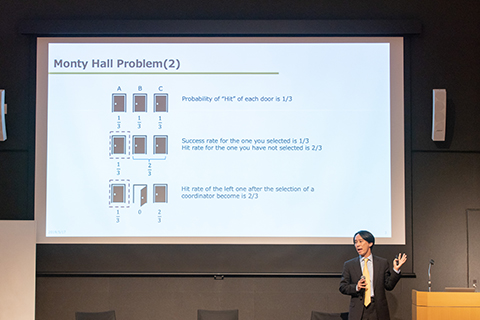

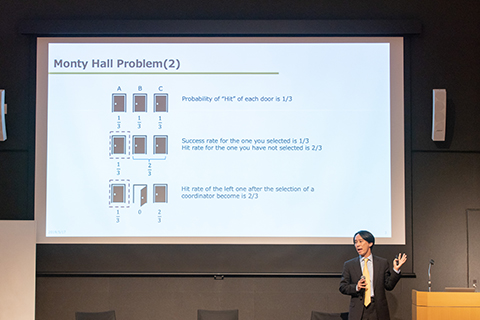

それを象徴する例として、福原正大氏は「モンティ・ホール問題」と呼ばれる、3つの扉から「当たり」の1枚を当てる統計学のゲームを挙げた。プレーヤーが左端の扉を選べば、それが正解である確率は3分の1、残り2枚に当たりが含まれる確率は3分の2となる。ここで中央の扉が外れと判明した場合、「残り2枚」を構成していた右扉の確率は3分の2となる。だが、左端を選んだプレーヤーに正解を推測し直すチャンスを与えても、人の大半は回答を変えないという。これに対し、人間に代わるAIのプレーヤーは、自動的に右扉に乗り変える。

このように、AIの利点は確率論にかなった「合理的意思決定」を可能にすることだと福原氏は説明した。

機械学習は、機械が行う「データ分析」のタイプに「学習」のパターンを掛け合わせて実現する。分析には基本的な線形回帰と、人間の脳の働きを模した「ディープ・ラーニング」を駆使した非線形回帰の2タイプがある。 また、学習には正解データを予め与える「教師あり学習」、AIが独自に答えをみつける「教師なし学習」、そしてAIの行動の結果に報酬を与える「強化学習」の3種類がある。AI開発の先端を行く最も重要な研究は、自律走行自動車の要でもある「ディープ・ラーニング」だと福原氏は話す。

では、経営の現場でAIはどう役立つのだろうか?

「自分に適切な人材を選べる自信はありますか?」

福原氏は、人事を一つの例として、会場を埋め尽くすフォーラム参加者にそう問いかけた。

「自信がある」と挙手したのは、2人のみ。「人間にしかない、相手を読み取る力というものがある」とコメントする参加者に、福原氏はその力を持って何を判断しているのかと聞いた。人間には偏見がつきものだと福原氏は強調する。出身校名から性別に至るまで、偏見の要素は限りなくある。

もちろん、AIを使えば問題が全て解決するというわけではない。アマゾンが、女性への偏見を示したAI採用ツールの開発を打ち切ったというニュースは記憶に新しい。だが、これは人間がAIに与えた判断基準に偏見があったからだと福原氏は指摘した。

「データにバイアスがある。これは、AIの問題というより、人間の問題なのです」

一般的に、就職面接で志願者の創造性を見抜くのは難しい。それは、志願者に自身のことを語らせるばかりで聴く力を試さないなど、能力の判定方法に問題がある、つまり、より良い人材を選ぶには、判断基準を設定するところからAIに任せればよいのではないか、というのが福原氏の考えだ。

英国のブレグジットや米国のトランプ氏の大統領選当選など、予期に反した政治的な出来事に加え、テクノロジーの目まぐるしい進化により、世の中がますます不透明になっているとホイカンプ氏は話した。企業の興隆と衰退の波も荒く、世界のトップ企業のリストは急速に更新されているという。いかに地球全域が密接に繋がっているかは、2010年のアイスランドの火山噴火による航空網麻痺でフィジー島の旅行産業が傾いたことからもわかる。

「今日のAIは意思決定の支援システムであり、ある事柄がどのくらいの確率で起こるのか、どういった影響をもたらすのかといった予測をしてくれる。そういう部分でAIは明らかに助けになる」とホイカンプ氏は話した。

「今日のAIは意思決定の支援システムであり、ある事柄がどのくらいの確率で起こるのか、どういった影響をもたらすのかといった予測をしてくれる。そういう部分でAIは明らかに助けになる」とホイカンプ氏は話した。

AIは偏見を持たずに解決策を選び、望ましい結果に導いてくれるという点でも有用だ。

しかし、何を望ましい結果と見なすかは、人間のみが決められることだとホイカンプ氏は強調した。組織内の部署統合を行った場合、コスト削減といったポジティブな効果もあるが、失業者の出現、更には従業員の士気への影響に至るまで、さまざまな結果が起こりうる。

「実際にどんな結果が重要なのか -- それをはっきりと決めるということは、自分たちがどういう組織または人間でありたいかという問題に関わってくるのです。すなわち、自分の価値観を知るということが大事です」

ホイカンプ氏は、この「価値の決定」を人間が負うべき究極の責任とみなす。

多数の人に短い文章を見せ、特定の文字がいくつ含まれているかと質問すると、回答者によってまちまちの答えが返ってくる。ホイカンプ氏はこうしたクイズを紹介し、また世界のトップ企業の売上高を会場の参加者に推定させながら、企業の知名度といった要素がいかに人の判断を左右するかも実証した。判断の拠り所となるような情報をわざと提示することによって、交渉相手の意思決定を操ることができることも、良く知られている事実だという。

人間が不得意とする情報分析や推測をAIに任せれば、人間の負担が軽くなることは間違いない。だからこそ、経営者や起業家は、人間の判断力の重みを認識する必要があるとホイカンプ氏は主張する。

「予測の面でいろいろな助けが得られるようになると、それに伴って意思決定すべきことも増える。だからこそ、さらに人間の判断力が求められるようになると、私は固く信じています」とホイカンプ氏は話した。

「また、予測にかかるコストが下がるので、その分、判断する力の経済的価値が上がっていきます。判断力を発揮できる人は責任ある任務を任せられるようになり、重要な仕事を行っていくでしょう」

ホイカンプ氏は、人間とAIを比較すること自体に異議を唱える。

「そもそも、『AIによる意思決定』というものは存在しないと主張したい」

状況によって物事の見方を変えて良いという「自由」は人間の特権であり、それが意思決定の前提となっているからだという。偏見は解決すべき問題であるが、そのためにAIに頼りすぎ、意思決定の最も重要な部分である「判断」を機械に任せてしまうのは避けたいとホイカンプ氏は語った。

福原氏も、「人間がAIに譲ってはならない領域がある」と話した。それは価値観や道徳に関わる事柄だ。自律走行の路上電車がどちらの方向に進んでも事故を起すと予測されるとしたら、5人死亡するシナリオをとるのか、それとも1人死亡する方向に路線を切り替えるのかは、操作員の道義にかかっている、と福原氏は説明した。

こうした「価値」に関わる選択を除いては、全ての面でAI化を進めるべきというのが福原氏のスタンスだ。データに基づいた意思決定をすることで、結果を評価する際にも証拠を提示できる。またAIの働きぶりと性能は、人間の能力をはるかに超えていることが多い。株の取引では、人間のトレーダーの稼ぎは、AIのトレーダーの足元にも及ばないと福原氏は話した。

議論が深まると、人間とAIの責任分担の境界線をどこに置くか、という点で、ホイカンプ氏と福原氏の対照的な考え方が浮き彫りとなった。

ホイカンプ氏は、必ずしも「AI化=改善」ではないと指摘した。

アマゾンのAI採用ツールは、人間の偏見を乗り越えられなかった。つまり、AIを使っても結果は変わらず、現状は改善されなかったというわけだ。良い組織を作るためにAIが必ずしも人間以上に貢献できるわけではないことは認識すべきだ、とホイカンプ氏は語った。

では、AIを使った採用の目的が純粋に売り上げ増加である場合はどうであろうか? 売り上げが伸びれば、たとえ採用面で性別に偏りが出たとしても、人間による意思決定よりも効果的であるという結論にならないだろうか?と福原氏は問いかけた。

ホイカンプ氏は、たとえ売り上げが伸びても、採用結果を見て「『本当にこれだけを基準として決めてよいのか?』と自問する必要はある」と話した。「それによって自分たちがどういう組織であるか、社会とどう関わり合っていくつもりなのか、を示す事になるからです」

犬猫を見分ける為に、膨大なデータを必要とするAI。それに対し、人間は僅かの経験から広がりのある推測をし、さまざまなものを識別することが出来る。

野田氏は、そんな人間が「人工知能」に惑わされてはならないという忠告を、友人でありロボット研究者として著名な大阪大学の石黒浩博士から受けたことがあると話した。

福原氏も、ロボットには少量の情報で物事を正しく推測する能力は、まだないと語った。

ホイカンプ氏は、人間による運転よりも自律走行車の方が安全である事からもわかるように、AIが人間の能力を超えているかどうかは領域にもよると指摘した。問題は、AIの能力が誇張されがちだということだ。

「人間は新しいものにすぐに夢中になってしまう傾向にある」と、ホイカンプ氏は述べた。

自ら学びながら最適な答えを導き出すAIに、何をどこまで、そしてどう委ねるか。それは、世界中のエグゼクティブが直面している難題だ。

AIと人間をどう使い分けるべきなのか?倫理的なAI活用法とは? そして、AI時代に求められる経営者像とは何なのか?

はじめに、MITの工学博士であり不確実性のもとでの意思決定分析の専門家として名高いIESEのフランツ・ホイカンプ学長、およびAIに基づく人材採用ツール開発会社「IGS」の創設者で至善館大学特任教授の福原正大氏が登壇し、経営におけるAIの未来について洞察を共有した。

その後、至善館大学の野田智義理事長の司会のもと、参加者からの質問も交えながら繰り広げられた白熱の議論を振り返ってみたい。

Franz Heukamp(IESE学長)

ディープラーニングは人間社会を救うのか?

人間は理不尽な動物だ。

人間は理不尽な動物だ。それを象徴する例として、福原正大氏は「モンティ・ホール問題」と呼ばれる、3つの扉から「当たり」の1枚を当てる統計学のゲームを挙げた。プレーヤーが左端の扉を選べば、それが正解である確率は3分の1、残り2枚に当たりが含まれる確率は3分の2となる。ここで中央の扉が外れと判明した場合、「残り2枚」を構成していた右扉の確率は3分の2となる。だが、左端を選んだプレーヤーに正解を推測し直すチャンスを与えても、人の大半は回答を変えないという。これに対し、人間に代わるAIのプレーヤーは、自動的に右扉に乗り変える。

このように、AIの利点は確率論にかなった「合理的意思決定」を可能にすることだと福原氏は説明した。

機械学習は、機械が行う「データ分析」のタイプに「学習」のパターンを掛け合わせて実現する。分析には基本的な線形回帰と、人間の脳の働きを模した「ディープ・ラーニング」を駆使した非線形回帰の2タイプがある。 また、学習には正解データを予め与える「教師あり学習」、AIが独自に答えをみつける「教師なし学習」、そしてAIの行動の結果に報酬を与える「強化学習」の3種類がある。AI開発の先端を行く最も重要な研究は、自律走行自動車の要でもある「ディープ・ラーニング」だと福原氏は話す。

では、経営の現場でAIはどう役立つのだろうか?

「自分に適切な人材を選べる自信はありますか?」

福原氏は、人事を一つの例として、会場を埋め尽くすフォーラム参加者にそう問いかけた。

「自信がある」と挙手したのは、2人のみ。「人間にしかない、相手を読み取る力というものがある」とコメントする参加者に、福原氏はその力を持って何を判断しているのかと聞いた。人間には偏見がつきものだと福原氏は強調する。出身校名から性別に至るまで、偏見の要素は限りなくある。

もちろん、AIを使えば問題が全て解決するというわけではない。アマゾンが、女性への偏見を示したAI採用ツールの開発を打ち切ったというニュースは記憶に新しい。だが、これは人間がAIに与えた判断基準に偏見があったからだと福原氏は指摘した。

「データにバイアスがある。これは、AIの問題というより、人間の問題なのです」

一般的に、就職面接で志願者の創造性を見抜くのは難しい。それは、志願者に自身のことを語らせるばかりで聴く力を試さないなど、能力の判定方法に問題がある、つまり、より良い人材を選ぶには、判断基準を設定するところからAIに任せればよいのではないか、というのが福原氏の考えだ。

福原正大 (Institution for a Global Society CEO Founder / 大学院大学至善館特任教授)

AI時代だからこそ増す経営者の責任

フランツ・ホイカンプ氏も、理にかなった分析と推測をしてくれるAIは有用な経営ツールであると考えている。経営には世界中の政治・経済システムやその裏にある数知れない要因を考慮する必要があり、社会が複雑になればなるほど展望が不透明になっていくからだ。英国のブレグジットや米国のトランプ氏の大統領選当選など、予期に反した政治的な出来事に加え、テクノロジーの目まぐるしい進化により、世の中がますます不透明になっているとホイカンプ氏は話した。企業の興隆と衰退の波も荒く、世界のトップ企業のリストは急速に更新されているという。いかに地球全域が密接に繋がっているかは、2010年のアイスランドの火山噴火による航空網麻痺でフィジー島の旅行産業が傾いたことからもわかる。

「今日のAIは意思決定の支援システムであり、ある事柄がどのくらいの確率で起こるのか、どういった影響をもたらすのかといった予測をしてくれる。そういう部分でAIは明らかに助けになる」とホイカンプ氏は話した。

「今日のAIは意思決定の支援システムであり、ある事柄がどのくらいの確率で起こるのか、どういった影響をもたらすのかといった予測をしてくれる。そういう部分でAIは明らかに助けになる」とホイカンプ氏は話した。AIは偏見を持たずに解決策を選び、望ましい結果に導いてくれるという点でも有用だ。

しかし、何を望ましい結果と見なすかは、人間のみが決められることだとホイカンプ氏は強調した。組織内の部署統合を行った場合、コスト削減といったポジティブな効果もあるが、失業者の出現、更には従業員の士気への影響に至るまで、さまざまな結果が起こりうる。

「実際にどんな結果が重要なのか -- それをはっきりと決めるということは、自分たちがどういう組織または人間でありたいかという問題に関わってくるのです。すなわち、自分の価値観を知るということが大事です」

ホイカンプ氏は、この「価値の決定」を人間が負うべき究極の責任とみなす。

多数の人に短い文章を見せ、特定の文字がいくつ含まれているかと質問すると、回答者によってまちまちの答えが返ってくる。ホイカンプ氏はこうしたクイズを紹介し、また世界のトップ企業の売上高を会場の参加者に推定させながら、企業の知名度といった要素がいかに人の判断を左右するかも実証した。判断の拠り所となるような情報をわざと提示することによって、交渉相手の意思決定を操ることができることも、良く知られている事実だという。

人間が不得意とする情報分析や推測をAIに任せれば、人間の負担が軽くなることは間違いない。だからこそ、経営者や起業家は、人間の判断力の重みを認識する必要があるとホイカンプ氏は主張する。

「予測の面でいろいろな助けが得られるようになると、それに伴って意思決定すべきことも増える。だからこそ、さらに人間の判断力が求められるようになると、私は固く信じています」とホイカンプ氏は話した。

「また、予測にかかるコストが下がるので、その分、判断する力の経済的価値が上がっていきます。判断力を発揮できる人は責任ある任務を任せられるようになり、重要な仕事を行っていくでしょう」

AIは人間を超えるのか?

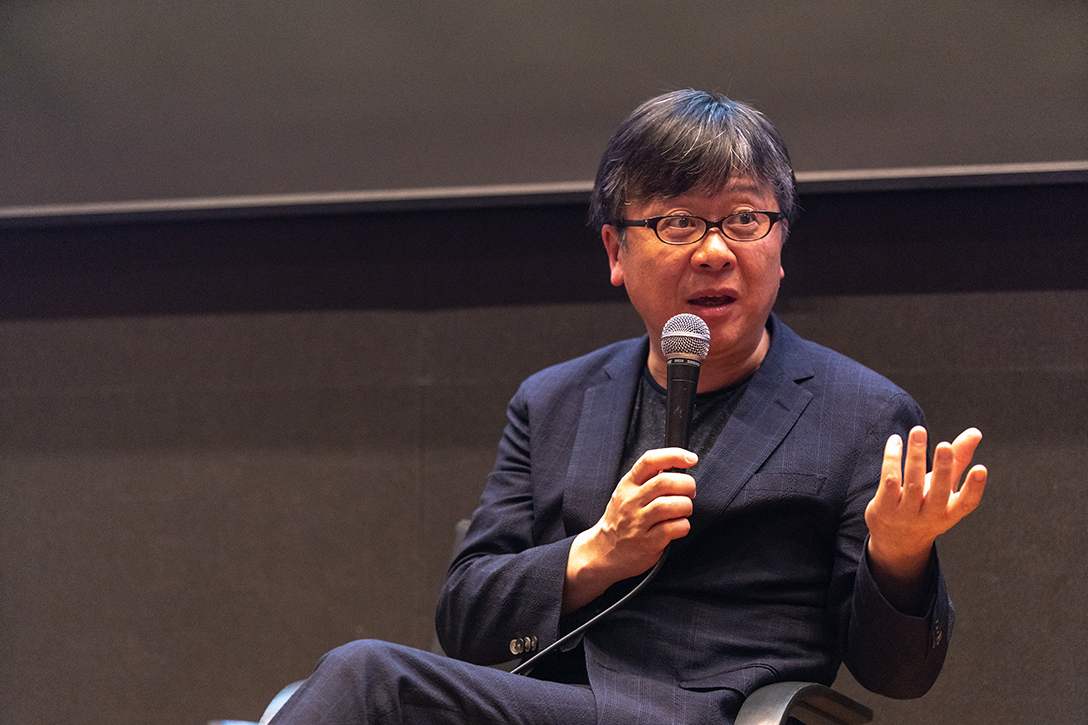

では、人間とAIの意思決定能力の違いはどこにあるのだろうか?AIには人間を超えられない限界があるのか?ホイカンプ氏は、人間とAIを比較すること自体に異議を唱える。

「そもそも、『AIによる意思決定』というものは存在しないと主張したい」

状況によって物事の見方を変えて良いという「自由」は人間の特権であり、それが意思決定の前提となっているからだという。偏見は解決すべき問題であるが、そのためにAIに頼りすぎ、意思決定の最も重要な部分である「判断」を機械に任せてしまうのは避けたいとホイカンプ氏は語った。

福原氏も、「人間がAIに譲ってはならない領域がある」と話した。それは価値観や道徳に関わる事柄だ。自律走行の路上電車がどちらの方向に進んでも事故を起すと予測されるとしたら、5人死亡するシナリオをとるのか、それとも1人死亡する方向に路線を切り替えるのかは、操作員の道義にかかっている、と福原氏は説明した。

こうした「価値」に関わる選択を除いては、全ての面でAI化を進めるべきというのが福原氏のスタンスだ。データに基づいた意思決定をすることで、結果を評価する際にも証拠を提示できる。またAIの働きぶりと性能は、人間の能力をはるかに超えていることが多い。株の取引では、人間のトレーダーの稼ぎは、AIのトレーダーの足元にも及ばないと福原氏は話した。

野田智義(大学院大学至善館 創設者・理事長 / 全人格リーダーシップ教育機関アイ・エス・エル(ISL) 創設者)

議論が深まると、人間とAIの責任分担の境界線をどこに置くか、という点で、ホイカンプ氏と福原氏の対照的な考え方が浮き彫りとなった。

ホイカンプ氏は、必ずしも「AI化=改善」ではないと指摘した。

アマゾンのAI採用ツールは、人間の偏見を乗り越えられなかった。つまり、AIを使っても結果は変わらず、現状は改善されなかったというわけだ。良い組織を作るためにAIが必ずしも人間以上に貢献できるわけではないことは認識すべきだ、とホイカンプ氏は語った。

では、AIを使った採用の目的が純粋に売り上げ増加である場合はどうであろうか? 売り上げが伸びれば、たとえ採用面で性別に偏りが出たとしても、人間による意思決定よりも効果的であるという結論にならないだろうか?と福原氏は問いかけた。

ホイカンプ氏は、たとえ売り上げが伸びても、採用結果を見て「『本当にこれだけを基準として決めてよいのか?』と自問する必要はある」と話した。「それによって自分たちがどういう組織であるか、社会とどう関わり合っていくつもりなのか、を示す事になるからです」

犬猫を見分ける為に、膨大なデータを必要とするAI。それに対し、人間は僅かの経験から広がりのある推測をし、さまざまなものを識別することが出来る。

野田氏は、そんな人間が「人工知能」に惑わされてはならないという忠告を、友人でありロボット研究者として著名な大阪大学の石黒浩博士から受けたことがあると話した。

福原氏も、ロボットには少量の情報で物事を正しく推測する能力は、まだないと語った。

ホイカンプ氏は、人間による運転よりも自律走行車の方が安全である事からもわかるように、AIが人間の能力を超えているかどうかは領域にもよると指摘した。問題は、AIの能力が誇張されがちだということだ。

「人間は新しいものにすぐに夢中になってしまう傾向にある」と、ホイカンプ氏は述べた。

「AI時代における企業経営者の意思決定とは」 インデックス

-

前編 AI時代だからこそ増す経営者の責任

2019年08月20日 (火)

-

後編 AIはビジネス戦略を変える

2019年08月20日 (火)

注目の記事

-

04月21日 (火) 更新

本から「いま」が見えてくる新刊10選 ~2026年4月~

毎日出版されるたくさんの本を眺めていると、世の中の“いま”が見えてくる。新刊書籍の中から、今知っておきたいテーマを扱った10冊の本を紹介しま....

-

04月01日 (水) 更新

【重要】「アカデミーヒルズ」閉館のお知らせ

「アカデミーヒルズ」は、2024年6月30日をもって閉館させていただくこととなりました。これまでのご利用ありがとうございました。閉館までの間....

-

03月24日 (火) 更新

本から「いま」が見えてくる新刊10選 ~2026年3月~

毎日出版されるたくさんの本を眺めていると、世の中の“いま”が見えてくる。新刊書籍の中から、今知っておきたいテーマを扱った10冊の本を紹介しま....